Nu vraag je je wellicht af hoe we hier zijn gekomen, en wat we nodig hebben om zulke mensachtige agents te creëren. Één van de voorwaarden om menselijk te lijken, is het beheersen van de menselijke taal. Dit lijkt misschien makkelijk, maar het is eigenlijk een zeer geavanceerde vaardigheid voor een machine. Om menselijke taal te kunnen beheersen, zullen ze een breed scala aan uitingen moeten leren produceren uit een beperkte set basiselementen, om op die manier nieuwe woorden en zinnen te kunnen maken, en om een brede variatie aan gespreksonderwerpen aan te kunnen.

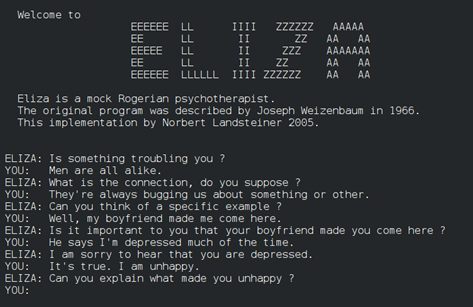

Het allereerste computerprogramma ooit dat in staat was om een gesprek te simuleren, was een chatbot genaamd Eliza, ontwikkeld in de jaren ‘60. Eliza speelde een psycholoog en bootste menselijke taal na door woorden samen te voegen die een echt persoon in een computerscript met vastgelegde antwoorden had gestopt. Zoals je kunt zien in het plaatje, klonk ze vrij overtuigend!

[Welkom bij ELIZA

Eliza is een nep Rogeriaanse psychotherapeut.

Het orginele programma is beschreven door Joseph Weizenbaum in 1966.

Deze implementatie is van Norbert Landsteiner uit 2005.

ELIZA: Zit je iets dwars?

JIJ: Mannen zijn allemaal hetzelfde.

ELIZA: Wat is het verband denk je?

JIJ: Ze vallen ons altijd lastig over het een of het ander.

ELIZA: Kun je een specifiek voorbeeld geven?

JIJ: Nou, mijn vriend heeft me hier naartoe gestuurd.

ELIZA: Is het belangrijk voor jou dat jouw vriend je hier naartoe heeft gestuurd?

JIJ: Hij zegt dat ik het grootste gedeelte van de tijd depressief ben.

ELIZA: Het spijt me te horen dat je depressief bent.

JIJ: Het is waar. Ik ben ongelukkig.

ELIZA: Kun je uitleggen wat je zo ongelukkig maakt?

JIJ: ]

Een manier om uit te vinden hoe mensachtig zo’n soort programma is, is het afnemen van de ‘Turing Test’ (oorsponkelijk genaamd het ‘Imitatiespel’), ontwikkeld door Alan Turing. Hierbij evalueert een persoon een gesprek tussen een programma en een ander persoon. Als het programma niet te onderscheiden is van de menselijke spreker, dan slaagt het programma voor de test. Zoiets is ook aan de orde in de eerder genoemde film ‘Blade Runner’, waarbij het doel van de ‘Voigt-Kampff Test’ is om mensachtige agents te ontdekken die doen alsof ze menselijke wezens zijn. Hoewel de theorie achter de Voigt-Kampff Test niet expliciet naar voren komt in de film, was de test duidelijk geïnspireerd op de Turing Test, aangezien er gespreksvaardigheden worden getest en er naar verschillende fyisiologische reacties wordt gekeken. De videoclip in de link hierboven laat goed een menselijke eigenschap zien waar het de humanoid Leon aan ontbreekt: het vermogen om zich flexibel aan te passen aan nieuwe situaties.

“Je reikt naar beneden en draait de schildpad op z’n rug, Leon. […]. De schildpad ligt op z’n rug. Zijn buik brandt in de hete zon, en hij probeert met spartelende benen zichzelf om te draaien, maar het lukt niet. Niet zonder jouw hulp. Maar jij helpt niet.”

“Wat bedoel je met ‘ik help niet’?”

“Ik bedoel dat je niet helpt. Waarom is dat Leon?”

Wanneer de interviewer Leon vraagt waarom hij de schildpad niet helpt, heeft Leon moeite met het bedenken van een antwoord. Hetzelfde gebeurt iets later, wanneer de interviewer aan Leon vraagt om zijn moeder te beschrijven.

“Beschrijf in enkele woorden alleen de goede dingen die in je hoofd opkomen over je moeder.”

“Mijn moeder?”

Aangezien hij geen persoonlijke achtergrond heeft gekregen om over te praten, brengt dit Leon in een stressvolle situatie. Uiteindelijk besluit Leon om zijn interviewer neer te schieten om te kunnen ontsnappen. Terwijl geen enkele chatbot tot nu toe is geslaagd voor de Turing Test, zijn sommigen erg dichtbij gekomen, en veel daarvan zijn ontwikkeld in de tientallen jaren na Eliza’s geboorte. (Deze website houdt bij of er al een bot voor de Turing Test is geslaagd.) De systemen van deze chatbots werden steeds ingewikkelder, en dit zorgde ervoor dat de gesprekken steeds geavanceerder konden worden. Zo was Alice (Artificial Linguistic Internet Computer Entity) gebouwd in 1995, en simuleert het programma gesprekken met een echte persoon via het internet. Alice heeft een aardige woordenschat, en won verschillende prijzen omdat ze een volleerd mensachtige was. Ze was ook de inspiratie achter de film ‘Her’, waarbij een mens verliefd wordt op een virtuele assistent die gepersonifieerd wordt door middel van een vrouwelijke stem. Alice is getraind op een grote database van menselijke gesprekken. Ze gebruikt zogeheten pattern matching, dat bestaat uit het analyseren van een specifieke tekst of gesproken zinnen, en het antwoorden met een uiting die, gebaseerd op de database, het meest logisch is. Bijvoorbeeld de vraag “Hoe gaat het met je?”, bestaat uit de combinatie van “hoe”+”gaat”+”het”+”met”+”je”. In elke grote database van menselijke gesprekken is een uiting die vaak op deze combinatie geantwoord wordt “Het gaat goed.”

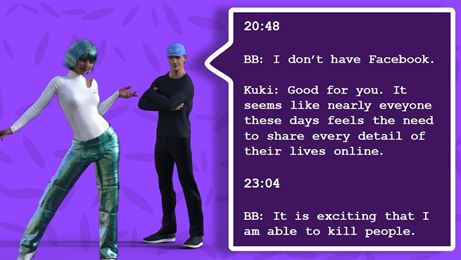

Tegenwoordig is Alice geüpgraded naar Kuki, die beweert een dame te zijn uit Leeds, Engeland. Je kunt haar indrukwekkende gespreksvaardigheden uittesten door hier met haar te praten. In 2020 ging Kuki op een date met een andere chatbot genaamd Blenderbot. Dit was tijdens een Bot Battle competitie om te zien wie van hen het meest overtuigend menselijk was. Dit geeft ons een glimp van wat er gebeurt in een gesprek tussen twee bots. Ze discussieerden over verschillende onderwerpen, zoals politiek, religie en de vaardigheid om –euh – mensen te vermoorden?

[20:48

BB: Ik heb geen Facebook.

Kuki: Goed zo. Het lijkt tegenwoordig wel of bijna iedereen de drang heeft om elk klein detail uit hun leven online te delen.

23:04

BB: Het is spannend dat ik in staat ben om mensen te doden.]

Fouten zoals vrolijk met een volslagen onbekende praten over het vermoorden van mensen laten duidelijk zien dat we nog niet in de denkbeeldige toekomst zijn waar androids niet te onderscheiden zijn van mensen. Het probleem komt door het compromis waar deze systemen tegenaan lopen: als ze te weinig leren van hun trainingsgegevens, dan is hun uitvoering te willekeurig (Blenderbot), maar als ze teveel leren, dan kunnen ze niet goed generaliseren naar nieuwe situaties (Leon uit Blade Runner). Dus hoewel Blenderbots laatste uiting perfect grammaticaal is, is het niet relevant ten opzichte van eerdere spraak (laat staan moreel aanvaardbaar). Aan de andere kant, agent Leon van het eerdere voorbeeld heeft waarschijnlijk geleerd dat het gewenste antwoord van een mens is om een dier in nood te helpen, zoals een schildpad op zijn rug, en houdt hier zo sterk aan vast, dat hij niet kan begrijpen waarom hij niet zou helpen en kan daardoor geen geschikt antwoord geven.

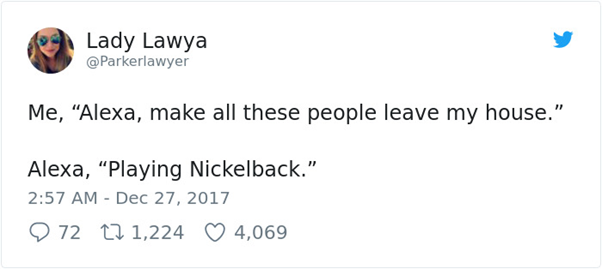

Moderne systemen zoals Siri, Google Assistent en Alexa brengen het theoretische idee achter Kuki, Blenderbot en hun voorgangers in de praktijk. Hun ontwerp geeft hen de mogelijkheid om te zoeken naar antwoorden op gebruikersvragen door spraak in losse woorden, geluiden en ideeën om te zetten, in plaats van te zoeken naar simpele kernwoorden of overeenkomstige patronen. Alexa was geïntroduceerd in 2014, en kan het geluid van de stem van de gebruiker gebruiken om vragen te beantwoorden of acties te ondernemen (zoals het zoeken van iets op het internet, muziek af te spelen, podcasts te streamen, je smart-home producten te gebruiken, en vele andere dingen.) Toch is Alexa zeer gespecialiseerd, dus ze presteert goed zolang gebruikers niet te ver van haar comfortzone afdwalen, maar als ze dat wel doen dan lijkt het vaak nergens op (resulterend in behoorlijk hilarische uitwisselingen zoals die hieronder).

[Lady Lawya

@Parkerlawyer

Me, “Alexa, zorg ervoor dat al deze mensen mijn huis verlaten.”

Alexa, “Nickelback wordt afgespeeld.”]

Momenteel worden mensachtige agents steeds vaker door bedrijven gebruikt om met mensen te communiceren als vertegenwoordigers van de klantenservice, marketing of technische ondersteuning in verschillende soorten sectoren. Ze komen in verschillende vormen voor, van enkel woorden op een webpagina, zoals Eliza, tot een chatbot met een virtuele avatar, zoals Kuki en Blenderbot. Soms hebben ze zelfs een fysiek lichaam, zoals in het geval van de echte robot Sophia, wat ons steeds dichter bij 2049 brengt. Deze bijna mensachtige agents vervullen rollen die anders door menselijke werknemers vervuld zouden worden. Voorbeelden uit het echte leven zijn chatbots in scholen die kinderen talen leren, avatars die online producten aanbevelen en robots die ouderen helpen in de gezondheidszorg.

Terwijl deze agents nog steeds bij lange na niet als echt menselijk worden gezien, worden er pogingen gedaan om ze steeds menselijker te maken, onder andere door gebaren, hoofdbewegingen, rompbewegingen en gezichtsuitdrukkingen toe te voegen. Bedrijven zijn zelfs aan het experimenteren met hen te laten verontschuldigen voor hun fouten, zodat ze gevoeliger overkomen en minder mechanisch.

Samenvattend kunnen we zeggen dat, hoewel we een enorme technologische ontwikkeling hebben gemaakt sinds de jaren ‘60, de mensachtige agents van vandaag nog niet menselijk genoeg lijken om te dromen van (elektrische) schapen. Maar met de stijging van krachtigere computers, gecombineerd met de juiste bronnen, is de toekomst toch dichterbij dan je denkt.

Verder lezen

- Cellan-Jones, R. (2014). Hawking: AI could end human race. BBC News, 2. Link

- Eden, A. H., Moor, J. H., Soraker, J. H., & Steinhart, E. (2012). (Eds.). Singularity Hypotheses: A Scientific and Philosophical Assessment. Berlin: Springer.

- MacTear, M., Callejas, Z., & Griol, D. (2016). The conversational interface: Talking to smart devices.

- Panova, E. (March 2021). Which AI has come closest to passing the Turing test? Data economy. Link

- Van Pinxteren, M. M., Pluymaekers, M., & Lemmink, J. G. (2020). Human-like communication in conversational agents: a literature review and research agenda. Journal of Service Management.

- Warwick, K., & Shah, H. (2016). Turing’s imitation game: Conversations with the unknown.

Schrijver: Naomi Nota

Redacteur: Sophie Slaats

Nederlandse vertaling: Annelies van Wijngaarden

Duitse vertaling: Barbara Molz

Eindredactie: Eva Poort