Als iemand iets tegen je zegt, dan laat diegene je weten wat er zich in haar hoofd afspeelt. Dat kan iets eenvoudigs zijn, bijvoorbeeld dat ze het eten lekker vindt, maar ook iets ingewikkelders, bijvoorbeeld dat ze twijfelt over wat ze na de zomer moet gaan studeren. Wat is er voor nodig om die zinnen te kunnen begrijpen? En begrijpt ChatGPT wel écht wat je zegt?

De betekenis van een zin

Om zinnen te begrijpen moeten we behoorlijk wat doen. Allereerst moeten we woorden herkennen in wat we zien (gebarentaal of geschreven taal) of horen (gesproken taal). Dit is al een flinke klus, maar daarna wordt het pas echt ingewikkeld: we moeten de betekenis van die woorden gebruiken om de zin te bouwen. Een zin betekent namelijk meer dan de losse woorden die erin staan.

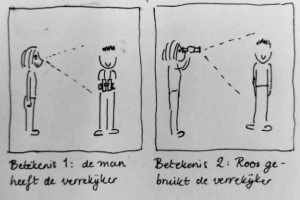

De betekenis van een zin is altijd een combinatie van minstens twee dingen: de betekenis van de woorden en manier waarop we deze woorden combineren. Dit weten we doordat sommige zinnen twee betekenissen kunnen hebben, terwijl alle woorden precies hetzelfde zijn. Taalkundigen noemen dit ambiguïteit. Een voorbeeld van zo’n zin is:

(1) Roos zag de man met de verrekijker.

De twee betekenissen komen tot stand als we de woorden op een andere manier combineren. Als we ‘de man’ combineren met ‘met de verrekijker’, ziet Roos een man die een verrekijker bij zich heeft (betekenis 1). Maar we kunnen ‘met de verrekijker’ ook combineren met ‘Roos’: in dat geval gebruikt Roos een verrekijker om de man te zien (betekenis 2).

Hoe werkt ChatGPT?

ChatGPT is een ‘Groot Taalmodel’ (in het Engels: ‘Large Language Model’, LLM). Grote Taalmodellen worden aan de hand van een grote hoeveelheid tekst getraind om te voorspellen wat het volgende woord in een zin zal zijn (lees hier meer (Engels)). ChatGPT gebruikt telkens de context om alle woorden die het model kent te ordenen van meest- tot minst voorspelbaar. Het meest voorspelbare woord wordt toegevoegd aan het antwoord. Als je dit vaak genoeg doet, krijg je mooie zinnen die ons doen vermoeden dat ChatGPT gedachten met ons deelt.

ChatGPT heeft dus wel degelijk een bepaalde kennis van taal, en sommige onderzoekers denken dat de manier waarop ChatGPT taal leert en gebruikt weleens overeen zou kunnen komen met hoe wij mensen dat doen – al is lang niet iedereen het daarmee eens (lees hier meer). Zelfs als er een vergelijking te maken valt, blijven er erg grote verschillen bestaan tussen de manier waarop ChatGPT taal verwerkt en hoe mensen dat doen. Een belangrijk onderscheid is dat ‘het volgende woord voorspellen’ niet hetzelfde is als ‘begrijpen wat er gezegd wordt’. Stel je voor dat je in een land bent waar je de taal niet begrijpt, en je elke dag langs een spandoek komt met woorden erop. Als je dat spandoek maar vaak genoeg ziet, kun je de volgorde van de woorden leren, maar je weet niet wat het opschrift betekent.

Dit is precies wat ChatGPT doet. Alle grote taalmodellen gebruiken kennis over welke woorden er vaak bij elkaar worden gebruikt om zinnen te maken die waarschijnlijk kloppen. ChatGPT is dus heel goed in het onthouden van woordcombinaties, maar heeft geen kennis van de bouwstenen van de betekenis: de abstracte structuur en de betekenis van de woorden.

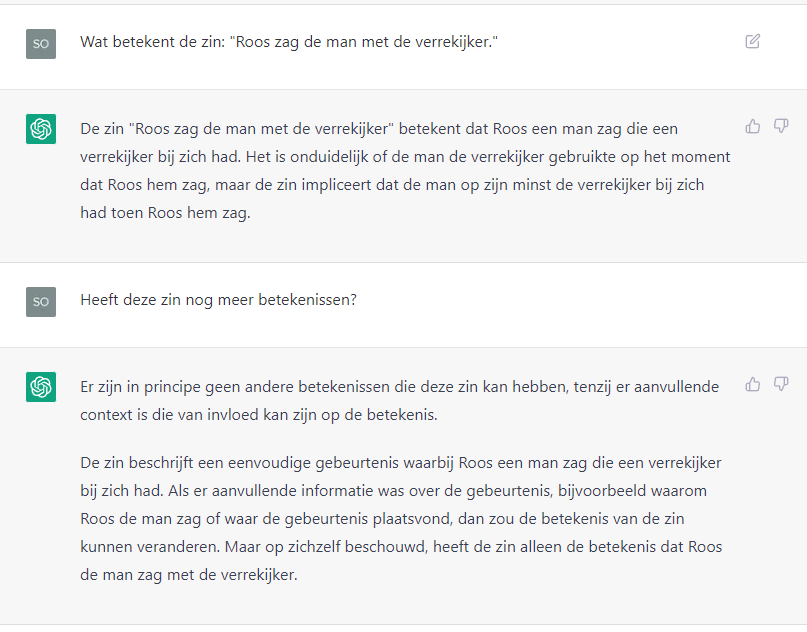

Wat zou er dan gebeuren als we ChatGPT vragen wat de zin in (1) betekent? Inderdaad: we krijgen een antwoord dat bestaat uit correcte zinnen, maar ChatGPT geeft ons alleen de meest waarschijnlijke interpretatie van de zin, en niet allebei (zie de afbeelding hieronder).

ChatGPT begrijpt dus niet wat je zegt, al lijkt dat misschien wel zo. Toch zal de bot altijd “ja” zeggen als we vragen of het ons begrijpt: ChatGPT heeft geleerd dat dit het meest waarschijnlijke antwoord is, maar zal nooit kunnen snappen waarom.